编译 | 陈骏达

编辑 | 李水青

智东西3月23日报道,在上周六发布的播客中,OpenAI联合创始人、AI大牛Andrej Karpathy(安德烈·卡帕西)系统梳理了自己在AI编程和OpenClaw浪潮中的一线体感与方法论,他笑称由于AI领域的飞速发展,自己仿佛出现某种“精神错乱”,在不同新事物之间疲于奔命。他还发现,当下AI编程智能体的瓶颈已不只是模型能力:“Agent做不好,多半是Skill问题。”

“我现在几乎一行代码都没再亲自写过。”在Karpathy看来,软件工程的工作流已经在短短几个月内被Agent彻底改写。现在不是人写代码,而是人用自然语言调度一群智能体完成系统级任务。过去他80%代码靠自己,如今变成80%交给Agent完成,甚至更高。

除了将Agent用于编程之外,OpenClaw的爆发也改变了Karpathy的生活。他打造了一个名为“多比”的OpenClaw,直接“接管”家庭,自动扫描并接入音箱、灯光、安防等设备,自主寻找API、建立控制面板,还能在陌生人接近时发预警。

这一经历让Karpathy得出判断:许多App都应该是Agent可调用的API,Agent就是粘合剂。OpenClaw之所以特别,不是因为某个功能最强,而是它更接近人们心目中的AI形态。

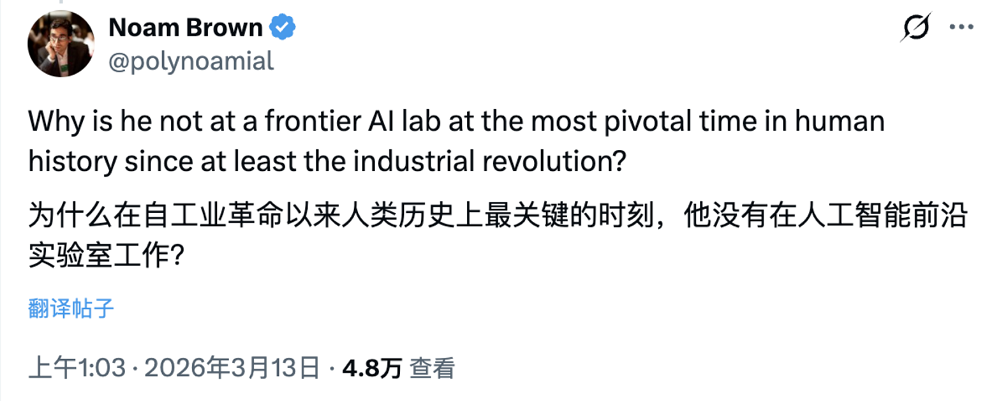

值得一提的是,在预告这期播客的推文下,Karpathy在OpenAI的前同事、OpenAI o1模型作者之一Noam Brown发了一条颇有“火药味”的推文,质疑Karpathy在这一关键时刻,为什么不在AI前沿实验室好好做研究。

对此,Karpathy也在播客中做出正面回应,如果深度绑定一家前沿AI实验室,就很难保持完全独立的立场,离开后反而与人类整体的立场更为对齐。财务激励与社会责任之间存在“利益冲突”,这也是OpenAI创立时就存在的问题,至今未能解决。

Karpathy认为,在前沿AI Lab干一段时间,做一些高质量工作,然后再离开,是个不错的方式——既能跟上真实进展,又不至于完全被某个实体控制,还给生态做了贡献。这番表态,颇有点“普罗米修斯盗火”的意味,或许真是他从OpenAI急流勇退的原因。

在这期播客中,Karpathy还就自动化研究、大模型能力“锯齿化”、开源与闭源竞争格局,以及AI对就业与软件形态的重构分享了自己的思考,以下是这期播客的核心内容:

1、AI编程:去年12月以来,AI编程的范式已经彻底改变,如今人其实不是在编程,而是在向Agent表达自己的想法。

2、生产力焦虑:行业目前最焦虑的已经不是能不能跑满GPU了,而是能不能用完token,“订阅没用完我就焦虑,说明我的token吞吐量没拉满。”

3、自动研究:AI已经能高度自动化地完成复杂研究任务,人类要做就是把人从所有流程中撤走,尽可能自动化,追求极高的Token吞吐量。

4、模型能力呈锯齿状分布:模型在不同领域的能力仍然参差不齐,如今与AI对话的感觉,就像是同时在和一个天才程序员和一个10岁小孩对话。

5、泛化问题:智能并没有全面溢出,可验证能力的提升并不会带动模型软性能力的提升。比如,模型在代码上变强了,但讲笑话还是五年前的烂梗。

6、职业选择:在前沿实验室工作并不自由,有太多利益纠葛和立场约束,在这些机构之外,反而更接近“人类整体”的立场。

7、开源v.s.闭源:完全封闭的智能还是有系统性风险的。开源模型如果并非最强,最好也只是稍微落后,扮演行业的“共同工作空间”角色,确保权力平衡。

8、单一大模型v.s.专用小模型:大模型会出现更多“物种分化”,但是持续学习、微调和权重修改等相关技术仍未成熟。

9、机器人:操作原子(物理世界)要比操作比特(数字世界)难上100万倍,但物理世界的总潜在市场(TAM)可能比纯数字世界还大。

10、AI与教育:人类互相教授知识的时代要结束了,未来教育的模式可能是先让agent搞懂,然后让它来教人。

以下是播客内容的完整编译:

01.

AI“龙虾”编程效果不佳?

多半还是Skill问题!

主持人:我记得有段时间走进你的办公室,看到你非常专注,我问你在做什么,你说“我必须每天‘编程’16小时”。编程甚至都不是正确的动词了,你其实是在向Agent表达自己的想法。跟我说说你的体验。

Karpathy:我感觉自己一直处在一种“AI精神错乱”(AI psychosis)的状态,现在也经常如此。因为作为个体,你能实现的事情变得更多了。过去你会受限于打字速度之类的因素,但现在有了这些Agent,情况完全不同了。

从去年12月开始,我的工作方式迎来真正的转折点:原本我手写80%的代码,剩余20%交给Agent,现在变成了20%自己写、80%交给Agent,甚至可能还不止80%。从那时起,我几乎一行代码都没再亲自写过。

随便找一个软件工程师,去看看他们在做什么,你会发现他们构建软件的默认工作流,从去年12月开始已经彻底改变了。

这是一个极其巨大的变化。我也跟我父母聊过这件事,其实普通人并没有意识到改变正在发生,或者没有意识到它有多戏剧性。

所以我现在的状态就像是“精神错乱”了一样,试图搞清楚到底哪些事是可行的,并把这些可能性推向极限。我会想:怎么能不局限于单次会话的Claude Code或Codex?怎么能拥有更多?怎么才能更合理地利用这些能力?这些OpenClaw到底能用在什么场景?新东西实在太多了。

我觉得自己必须站在最前沿。我在Twitter上看到很多人在做各种尝试,听起来都头头是道。如果我不处在前沿,就会感到非常焦虑。这种“精神错乱”状态,本质上是因为我们还在探索“什么是可能的”,而这个领域从根本上说仍是未知的.

主持人:如果你都感到焦虑,那我们其他人就更不用说了。我们有个合作团队,他们的工程师完全不手写代码,所有人都戴着麦克风,一直对Agent低语。这是有史以来最奇怪的工作场景。我以前觉得他们疯了,现在我完全接受了,“哦,这才是正道”。你只是领先了一步。你觉得现在自己探索或做项目的能力受限于什么?

Karpathy:Agent做不好,多半是人没掌握好Skill。不是它不行,是你还没摸清楚怎么把现成的东西组合起来。比如agents.md文件里的指令写得不够好,或者没配个好用的记忆工具,归根结底都是Skill问题。

最好的办法是让Agent并行干活,就像Peter Steinberg(OpenClaw作者)那样。Peter有张特别逗的照片——他坐在显示器前,屏幕上铺满了一堆Codex Agent。如果提示词写得对,再开个高强度推理模式,每个任务差不多要跑20分钟。他手上大概有10个repo要检查,就来回切换着给Agent分配工作。

这样你就能用更大的颗粒度去操作了,不是“这儿改一行代码,那儿加个新函数”这种小打小闹,而是“这个新功能交给Agent 1,那个新功能不冲突,给Agent 2”,然后根据你对代码的重视程度去审查它们的产出。

这些就是操作代码仓库的“宏观动作”。一个Agent在做研究,一个在写代码,另一个在规划新的实现方案,所有事都在这些宏观动作里推进。你得努力精通这套玩法,练出肌肉记忆。这事儿特别有回报,一来是真的有用,二来是你在学新东西。所以才会“精神错乱”。

02.

“订阅没用完我就焦虑,

说明我的token吞吐量没拉满”

主持人:我的直觉是,每次等Agent干完活儿,都觉得自己应该多干点别的,对吧?如果token还富余,就该并行塞更多任务进去。这挺有压力的,因为要是你不觉得token花费是瓶颈,那系统里真正的瓶颈就是你自己了。

Karpathy:起码说明你订阅的额度没用满。理想情况下,Codex跑满了就该切到Claude或者别的。我最近一直在试这个模式,订阅没用完我就焦虑,说明我的token吞吐量没拉满。

我读博的时候其实也经历过这种事,GPU没跑起来就焦虑——明明有GPU算力,FLOPS却没榨干。但现在不是FLOPS了,是token。你的token吞吐量是多少?你指挥着多少token在跑?

主持人:我觉得挺有意思的,过去至少十年,很多工程任务里大家都不觉得受计算限制,而目前整个行业突然变得受资源限制了。现在能力突然跃升了,你就会发现“哦,原来不是我搞不到算力,瓶颈是我自己”。

Karpathy:是Skill问题。研究这事儿能让你变得更好。我觉得挺上头的,因为你变强了就会解锁新东西。

主持人:你觉得会往哪儿发展?比如Karpathy每天迭代16小时,其他人也在用编程Agent变强,一年后你达到的精通水平,会是什么样?

Karpathy:精通是什么样?年底,还是两年、三年、五年、十年后?我觉得大家都想往技术栈的上层走。不是单次和Agent聊天,而是多个Agent怎么协作、团队怎么配合,大家都在摸索那会是什么样。

然后我觉得OpenClaw也是个有意思的方向,因为我说的OpenClaw是指那种把持久性提升到新层次的东西。它是那种持续循环运行的,不是你交互式参与的,它有自己的小沙盒,自己干事儿,哪怕你不盯着,还有更复杂的记忆系统之类的,这些Agent里还没实现。

OpenClaw的记忆系统就比默认的大模型复杂多了,默认只是上下文满了就压缩记忆。

主持人:你觉得OpenClaw是不是凭借这一点打动了用户,还是更广泛的工具访问?

Karpathy:我觉得OpenClaw有很多非常好的想法。Peter做得特别棒。我最近见到他聊过,他挺谦虚的,但我觉得他同时在五个不同维度创新,然后整合到一起。比如那个“灵魂文档(soul.md)”,他真的精心打造了一种有吸引力、有意思的人格。我觉得现在很多Agent都没做对这点。

Claude的人格就不错,感觉像队友,跟你一起兴奋。有意思的是ChatGPT里的Codex很活泼、很有活力,但Codex这个编程Agent就很枯燥,好像不在乎你在创造什么,虽然完成了,但是它好像不理解我们在构建什么。

主持人:确实。

Karpathy:还有一点,比如Claude,我觉得他们把模型的“人格”调得挺好。Claude夸我的时候,我确实觉得配得上。因为当我给它的想法不太成熟的时候,它反应就不强烈。但按我自己的标准,真是好想法的时候,它好像会多奖励一点。我有点想赢得它的夸奖,这真挺奇怪的。

人格很重要,很多其他工具可能没那么重视。Peter真的很在乎这个,所以做对了。然后是记忆系统,还有通过单一WhatsApp入口,访问所有功能,这个设计很不错。

03.

“一切都应该是API端点,

Agent是粘合剂”

主持人:你个人用OpenClaw做过什么编程之外的有意思的事吗?

Karpathy:1月份的时候,我经历了一段“OpenClaw精神错乱”时期。我搭了个照顾家的OpenClaw,叫它“家养小精灵多比”。我用Agent找家里局域网上所有智能家居子系统,还挺惊讶居然开箱即用。

我只是跟它说“家里有Sonos,你能找找吗?”它就做了IP扫描,找到Sonos音箱,结果没密码保护,直接登进去了。然后它开始逆向工程,看看这些系统是怎么工作的,也做了些网络搜索,直接找到API端点,问我想试试吗,然后音乐就出来了。

灯光也一样。它基本上是黑进了系统,搞清楚了整个系统,创建了API,创建了仪表盘,我能看到家里所有灯的指挥中心,然后开关灯。我可以跟它说:“多比,要睡觉了”。这条指令就可以把所有灯关掉,它还控制着我所有的灯、空调、窗帘、泳池、水疗吧,以及安保系统。

我有摄像头对着房子外面,每次有人进来,首先会进行变化检测,然后基于变化检测去调Qwen,最后给我发WhatsApp消息,显示外面的图像,比如:“嘿,FedEx卡车刚到了,你可能想检查一下,你收到邮件了。”这是多比刚给我发的,真的很不可思议。

多比管着房子,我通过WhatsApp跟它发消息,这些宏观动作真的很有意思。我还没真正推得更远,我觉得有人在做更疯狂的事。但就算只是家庭自动化设置,我以前要用六个完全不同的App,现在不用了,多比用自然语言控制一切,很神奇。我觉得我还没完全推到这个范式的极限,但已经很有帮助、很有启发了。

主持人:你觉得这从用户体验角度说明了人们想要什么吗?因为学习新软件、新UI是需要人类努力的,这在过去被忽视了。

Karpathy:某种程度上是对的。OpenClaw实现的东西,本质上是从“人们觉得AI应该是什么样”这个角度倒推出来的。人们心目中的AI其实不是原始意义上的大模型——大模型就是个token生成器,但人们想象中的AI是那种有人格、有身份的存在,你可以跟它分享事情,它也会记得,就像WhatsApp背后的某个实体,更好理解。

所以某种程度上说,OpenClaw匹配了人类对AI行为的既有期望,但底层有很多技术细节。比如大模型作为原始原语对大多数人来说太“原始”了,对很多人来说不能真正被当成AI来看待。

主持人:我觉得这就是我们理解AI的方式,把它描述成多比或某种人格显然能引起共鸣。我觉得你把六个不同的软件系统统一起来做家庭自动化,也指向另一个问题:人们真的想要我们今天拥有的所有这些软件吗?你所做的就是把这些硬件的软件层或UX层扔掉了。你觉得这是人们想要的吗?

Karpathy:我觉得有种感觉是,应用商店里那些配套智能家居设备的App,某种意义上根本不应该存在——不应该就是个API吗,Agent不应该直接调用吗?我能做各种家庭自动化,任何单个App都做不到。大模型能驱动工具、调用所有正确的工具、做相当复杂的事。

这说明业界可能生产了太多定制App,它们不应该存在,因为Agent把它们都统一起来了,一切都应该更像是暴露出来的API端点,Agent是粘合剂,是实际调用所有部分的智能。

另一个例子是我的跑步机,有个跑步机App,我想记录做有氧的频率,但我不想登录网页UI、走流程什么的。这些都应该只是开放的API,这是走向Agent化网络或Agent优先工具的方向。所以行业必须在很多方面重新配置,客户不再是人类,而是代表人类行事的Agent,这种重构可能会相当彻底。

有人反驳说,我们期望人们vibe code这些工具吗?普通人要做我刚才描述的这些吗?但某种程度上这只是今天的技术现状,现在有vibe coding,我在观察、在跟系统合作。

但我觉得我刚才说的这些,一两年或三年后应该是免费的,没有vibe coding参与,这是微不足道的,是基本要求,任何AI甚至开源模型都能做这个。

主持人:大模型应该能很容易地把不熟悉技术的人的意图,翻译回去。

Karpathy:今天还是需要vibe coding,但没多少人会做。

主持人:而且你还得做些设计决策,对吧?比如取帧。

Karpathy:但我觉得门槛会降下来,只是为你服务的临时软件,某个OpenClaw处理所有细节,你不参与。它有台机器,会搞清楚,只给你呈现UI,你说话就行。

主持人:你为什么没把个人用OpenClaw的边界推得更远?是因为你专注更重要的项目,比如自动研究,还是在研究如何精通Vibe Coding,或者其他原因?

Karpathy:我觉得我分心了。我花了一周在OpenClaw的东西上,但还有更多尝试可以做。我没给它邮件、日历和其他东西的访问权限,因为我还有点怀疑。它还很新、很粗糙。我不想给它我数字生活的完全访问权。部分原因是安全、隐私,也许这是主导因素。但部分也确实是因为我被分心了。

04.

AI已能“自动研究”

人类别拖后腿

主持人:你探索“自动研究”的动机是什么?你一直在说,想让Agent做训练或至少优化模型的任务。

Karpathy:我早先有条推文,大意是为了充分利用现在可用的工具,你必须把自己从瓶颈中移除,你不能在那里写提示词,指挥模型做下一件事,需要把自己抽离出来,安排好任务让它们完全自主。怎么在不参与循环的情况下,最大化你的token吞吐量,这才是目标。

现在要做的就是增加你的杠杆,我只输入很少的token,偶尔一次,但是有大量事情正在发生。

人们喜欢这个概念,但可能没完全想通含义。对我来说,自动研究员就是上述观点的案例之一——我不想做研究者,看结果什么的,我在拖系统后腿,所以问题是怎么重构所有抽象层。

我们要做的就是让Agent能运行更长时间、不用你参与、代表你做事。所谓的自动研究员就是,你告诉Agent,这是目标,这是指标,这是能做和不能做的事情,放手去做吧。

主持人:你对它的有效性感到惊讶。

Karpathy:对,我没想到会有效。我有nanoGPT这个项目,很多人不理解我对训练GPT-2模型的着迷,但对我来说,训练GPT模型只是个小工具、小游乐场。我真正更感兴趣的是递归自我改进这个想法,以及大模型能在多大程度上改进大模型。所有前沿实验室都在做这件事,他们都在大致尝试递归自我改进。

这个项目对我来说就是一个小游乐场。我已经用经典的手工方式调过nanoGPT了——我是研究者,做了大概二十年。我做了很多实验,做了超参数调优,做了所有事,非常熟练,达到了某个点,我觉得调得相当好了。

然后我让自动研究跑了一晚上,它给我带来了我忽略的调优空间,比如我确实忘了值嵌入的权重衰减,我的Adam beta没充分调好,这些东西是联合交互的,一旦调一个,其他的也可能要变。

我不应该是瓶颈,我不应该跑这些超参数搜索优化,我不应该看结果,这种情况有客观标准。所以你只需安排好Agent,让它能一直跑下去。我很惊讶它找到了这些调优空间,代码库已经高度优化了。

而这还只是单循环,前沿AI实验室有数以万计GPU的集群。不难想象,可以在较小模型上进行大量这种研究。所有前沿AI模型都是关于外推和Scaling损失的,可以在较小模型上做大量探索,然后尝试外推出去。

主持人:你的意思是,如果能更好地进行这种实验,那研发效率会大幅提升,在扩大模型规模时,也会有更明确的方向。

Karpathy:是的。我觉得目前最有趣、可能也是顶尖实验室正在攻克的项目,就是在小模型上做实验。你会试图让实验过程尽可能自动化,把研究员从环节中踢出去。研究员们往往有种“过度自信”,其实他们不该插手这些过程。你得重写整个流程,虽然现在研究员还能提供点想法,但不该由他们去执行。

想象一下,有一个点子队列,可能还有一个“自动化研究员”,它根据所有的arXiv论文和GitHub仓库产生灵感并输入队列;人类研究员也可以贡献点子,但它们都进入同一个队列。然后由自动化Agent去抓取任务并尝试。行得通的代码就进入功能分支,人工只需偶尔监控一下并合并到主分支。

总之,就是把人从所有流程中撤走,尽可能自动化,追求极高的Token吞吐量。这需要重新思考所有的抽象层,一切都要推倒重来。这非常令人兴奋。

05.

AI能力呈“锯齿状”分布:

有时像天才,有时像10岁小孩

主持人:如果我们再往深处推演一级,模型什么时候能写出比你更好的“program.md”?

Karpathy:“program.md”是我尝试描述自动化研究员如何工作的一个简陋草案——比如“先做这个,再做那个,尝试这些架构或优化器的点子”。我只是用Markdown随手写出来的。你肯定想要一种自动化研究循环,去寻找更优的方案。你可以想象,不同的“program.md”会带来不同的进展。

每一个研究机构其实都可以由一个“program.md”来描述。一个研究机构就是一组描述角色和连接方式的Markdown文件。你可以想象一个更高效的机构:也许他们早上的会更少,因为那纯属浪费时间。既然这一切都是代码,你就可以微调它:有的开会少,有的偏好高风险。

你可以打造多个不同的研究机构,每个机构都以代码表示,有了代码就可以对其进行优化。你可以分析进步是从哪儿来的,然后调整“program.md”,让它多做有效的事,少做没用的事。

主持人:这就是元优化(Meta Optimization)。

Karpathy:这主意很棒,但得一步步来。这就像剥洋葱:现在大模型部分已经是常态了,智能体部分也是常态了,像OpenClaw也是常态了。现在你可以拥有多个实体,给它们指令,甚至对指令进行优化。这信息量确实有点大,甚至让人感觉有点“精神错乱”,因为它是无限嵌套的,而且一切都还处于早期阶段。

主持人:如果我们要判断当下,什么样的技术才是核心?我们是否应该在各个领域都尝试实现这种“去人化”的自动化循环?核心是建立指标,还是创造让Agent在没有你的情况下持续工作的能力。那“性能工程”(Performance Engineering)还有地位吗?

Karpathy:关于AI生态我有几点想提醒。第一,这种模式极其适合那些有客观指标、易于评估的领域。比如编写更高效的CUDA算子。有一段低效代码,想要一段行为完全一致但速度更快的高效代码,这是自动化研究的完美场景。但如果你无法评估,你就没法对其进行自动化研究。

第二,虽然我们能看到下一步,但模型的基本功层面其实还有很多不足,没完全跑通。如果你步子跨得太大,最后可能反而没用。现在的模型虽然进步很大,但在某些方面还是比较粗糙。我感觉自己同时在和一个天才级的系统程序员以及一个10岁小孩对话。

这种“锯齿状”(Jaggedness)的能力分布很奇怪,人类的能力通常更均衡。有时候我要求一个功能,结果Agent给我的完全是错的,然后陷入完全错误的循环,我就特别崩溃。明明能感觉到它的强大,但它偶尔还是会干出完全没道理的事情。

06.

模型能力“泛化”仍然存疑,

一切都卷在不透明的神经网络里

主持人:当我发现Agent在一些显而易见的问题上浪费了大量算力时,我会非常恼火。

Karpathy:我猜这背后的深层原因是:这些模型是通过强化学习(RL)训练的。它们也面临我们刚才聊到的问题:实验室只能在可验证、有奖励反馈的领域提升模型。代码写对了吗?单元测试过了吗?这些好办。

但它们在比较“软”的东西上就挣扎了,比如:我到底想要什么细微差别?我意图是什么?什么时候该反问我求澄清?凡是感觉比较模糊、不明确的领域,它们就明显差很多。

所以你要么就在轨道上,属于超级智能的一部分,要么就偏离轨道,进入了不可验证的领域,然后一切就开始漫无目的地游荡。

换个说法:你今天去用最强的ChatGPT,说“给我讲个笑话”,你大概率知道会得到哪个笑话。

主持人:我猜ChatGPT大概翻来覆去就那三个笑话。

Karpathy:没错。所有大模型最爱讲的笑话永远是:“为什么科学家不信任原子(Atoms)?因为它们构成了(Make up,也有编造之意)一切。”

这是三四年前模型讲的笑话,现在依然是。尽管模型在Agent任务上已经能移山填海,可你一让它讲笑话,它还是五年前的烂梗。

因为这不在强化学习的优化范围内,它是“锯齿状能力”中的洼地。模型能力提升的同时,讲笑话的能力并没有提升。它没有优化,而是停留在了原地。

主持人:这是否说明我们在“泛化”意义上并没有看到更广的智能——比如讲笑话的聪明度并没有跟写代码的聪明度绑定在一起?

Karpathy:对,我觉得确实存在一定程度的解耦。有些东西可验证、被重点优化;有些东西没有被优化。有些领域实验室根据训练数据随意优化,有些根本没动。

主持人:有一些研究组的前提是:如果你在代码生成等可验证领域变得更聪明,就应该在所有领域都更聪明。但笑话这个例子说明,至少目前并没有发生全面的溢出。

Karpathy:我也不觉得发生了。我觉得有一点点,但远没有达到让人满意的程度。

主持人:人类也有这种特质。你可以数学极其厉害,但讲笑话巨烂。

Karpathy:但这也说明,我们并没有得到那种“模型越强,所有领域的智能都自然而然跟着变强”的故事。并不是这样。存在盲区,有些东西根本没被优化。这一切都卷在不透明的神经网络里。

如果是获得针对性训练的能力,就会光速前进,如果不在这一范围内,表现就不佳。这就是能力的参差不齐。

即使方向很明显,也还不能完全放手让它跑,因为它还没完全跑通——要么是技术还没成熟,要么是我们还没搞明白怎么用。

07.

大模型会出现更多“物种分化”

但相关技术仍不成熟

主持人:我能问一个有点大逆不道的问题吗?我们现在还是把模型打包成一个单体模型,但如果这种参差不齐的能力分布会一直存在,那是否应该把模型拆开,拆成可以在不同智能领域分别优化、分别改进的东西?比如拆成多个专家模型(Mixture of Experts),每个专注不同领域。

而不是现在这样:一个大模型什么都行,但为什么在这件事上表现很好、在另一件事上表现极差,让人非常困惑。

Karpathy:我现在的感觉是:前沿实验室还是想做一个单一的“单文化”模型,在所有领域都尽可能聪明,然后把一切都塞进参数里。但我认为未来应该会出现更多的“物种分化”(speciation)。

就像动物界,大脑形态极其多样,有各种生态位。有些动物视觉皮层超级发达,有些其他部分超发达。我们应该也会看到更多这种分化。

不需要一个无所不知的神谕(oracle)。你可以让它分化,然后针对特定任务部署。而且这样可以出现更小的模型,但仍然保留认知核心,仍然很能干,只是在特定任务上做了特化。

这样在延迟、吞吐量上都会更高效。比如专门为Lean定理证明做优化的模型,已经有几家在发布了。应该会出现越来越多这种解耦的场景。

主持人:我有一个问题是:当前计算基础设施的容量限制,会不会反过来推动这种分化?因为效率变得更重要了。因为如果算力完全不限,你什么都能跑,哪怕是一个超大单模型。但如果你真切感受到:我不可能为每一个用例都开一个巨型模型。你觉得这会不会推动分化?

Karpathy:这个问题很有道理。但我现在的困惑是:我们其实还没看到太多分化。目前还是单一模型占主导。

主持人:业界明显有压力,要做一个好的编程模型,然后再合并回主干。

Karpathy:尽管模型本身已经有很大压力了。

主持人:也许现在是短期供给极度紧张,反而会造成更多分化。

Karpathy:对。我觉得本质上,实验室在对外提供模型时,他们并不知道终端用户会问什么。所以他们必须在所有可能的问题上进行多任务规划。

如果你是跟某个企业深度合作、针对特定问题,那可能会出现更多特化。或者某些极高价值的细分应用。但目前他们还是在追求“包罗万象”。

另外,操控这些“脑”的科学本身还没完全成熟。比如在不损失通用能力的情况下做微调,同时,我们也还没有很好的原语(primitives)。现在基本上靠上下文窗口来操控,它确实很好用、很便宜,所以我们用它做各种定制化。

但如果想更深层地调整模型,比如持续学习(continual learning)、在特定领域微调、真正动权重而不是只动上下文窗口,这要复杂得多。动权重实际上是在改变整个模型的智能,很容易出问题。所以“物种分化”的科学本身还不成熟。

主持人:而且成本也要足够低,才值得去做。

08.

AI研究“并行化”展现潜力

“散户”也能贡献算力

主持人:我能再问一个关于你之前提到的“自动研究”(auto research)的问题吗?你谈到过“开放地带”(open ground),说我们需要围绕它建立更多的协作表面,让大家都能参与到整体研究中。你能再讲讲这部分吗?

Karpathy:好的。我们之前聊到,研究本质上是一条单线程:我不断尝试、循环迭代。但真正有趣的部分其实是它的并行化。我尝试过一些想法,但目前还没有找到特别简单、让我特别满意的方案,所以这只是我业余时间、在不做OpenClaw时顺手捣鼓的一个方向。

一个很直接的思路是:如果你有很多并行节点,很容易就能让多个自动研究员(auto researchers)通过一个共享系统互相讨论。但我更感兴趣的是,如何让互联网上大量不被信任的工人(untrusted pool of workers)参与进来。

举个例子,在自动研究里,我们的目标是找到一段能把模型训练到非常低验证损失的代码。如果有人从互联网上提交一个候选commit,你很容易验证它到底好不好——直接跑一下就知道。

但验证本身虽然简单,却可能要消耗大量算力。而且对方完全可能撒谎。所以这里其实有点像我之前设计的一些系统,引入了不信任的工人池,结构上有点像区块链。

这些commit可以互相建立在前面,包含代码的改进。所谓的“工作量证明”其实就是大量实验,找到真正有效的commit。现在的奖励只是上排行榜,没有任何金钱激励。

我不想把这个类比推得太远,但核心问题是:搜索的成本非常高,但验证一个候选方案是否优秀却非常便宜——你只需要训练一次模型,看看它到底行不行。前面可能试了1万个想法失败了,但你只要验证那个成功的就够了。

简单来说,你需要设计一套系统,让不被信任的工人池和可信任的验证工人协同工作,整个流程是异步的、安全的。从安全角度看,如果有人随便发一段代码给你,你直接跑它是非常危险的。但理论上这是完全可行的。

你应该很熟悉SETI@home(在家搜寻地外文明)、Folding@home(在家研究蛋白质折叠)这些项目,它们都有非常相似的性质:找到一个低能量蛋白质构象非常难,但一旦有人找到了,你很容易验证它就是低的。

所以凡是符合“生成极贵、验证极便宜”这个特性的问题,都很适合用“@home”模式,比如Folding@home、SETI@home,或者未来的“Auto Research @ home”。

一句话总结:互联网上的一大群智能体有可能合作来改进大语言模型,甚至有可能跑赢前沿实验室,谁知道呢?前沿实验室拥有大量可信算力,但地球上不被信任的闲散算力总量要大得多。

如果能把机制设计好,让安全验证到位,也许真的有可能让这群“散户”贡献算力,共同推动某些他们关心的方向。

再延伸一点,很多公司、机构、甚至个人研究方向都可以有自己的自动研究赛道。比如你特别关心某种癌症,你不只是捐钱给机构,你还可以买一些算力,然后加入那个癌症方向的自动研究“池子”。这样算力就变成了一种你可以贡献的东西,所有研究者最终都在共享、竞争、迭代这些算力成果。

主持人:这真的很振奋人心。而且很有意思的一点是,现在至少有一部分人——不管是硅谷排队买显卡的,还是中国商场里抢设备的——突然又觉得拥有个人算力变得有意思了。

Karpathy:对。

主持人:他们可能为了自己的OpenClaw去买算力,然后顺便贡献给自动研究。

Karpathy:现在大家都在乎美元,但未来会不会变成大家都在乎FLOP(浮点运算次数)?会不会出现一种“翻转”——算力变成真正稀缺和主导的东西?当然我不认为会完全这样,但这个想法挺有意思的。

09.

AI是数字世界的“幽灵”

进入物理世界仍会滞后

主持人:你最近发布的好像是对一些就业数据的分析,对吧?好像还稍微触动了一些人的神经,虽然你只是可视化了公开数据。你当时主要是好奇什么?

Karpathy:对。我就是很好奇AI对就业市场的真实影响到底会怎样。每个人都在讨论这个话题。所以我就想看看现在的职业分布是什么样子、各个职业有多少人,然后逐个去想:以AI目前和未来可能的演化路径,这些职业是会被AI当作工具来增强,还是会被取代?它们是会增长、萎缩,还是会发生很大变形?会不会出现全新的职业?

所以这其实主要是喂养我自己对整个行业的思考链条。我看的是美国劳工统计局(BLS)的数据,他们对每个职业未来十年(大概是基于2024年的预测)都有一个预期增长百分比。

主持人:我们需要很多医疗工作者。

Karpathy:对,他们已经做了这些预测。我不清楚他们的具体方法论是什么。我当时主要按“数字vs物理”来给这些职业分类。

因为我觉得目前主流发展的AI更多是数字世界的“幽灵”——它们能非常高效地操纵数字信息,但还没有真正的物理具身。操控原子永远比操纵比特慢很多个数量级。

所以我预期数字空间会发生爆炸式的活动、重写、沸腾,而物理世界会相对滞后一段时间。数字领域的“神经系统”会被AI大幅升级,带来大量原本由人和传统计算机完成的数字信息处理工作被重构(refactoring)。而物理世界会慢半拍。

所以我特别把那些本质上就是在家里操纵数字信息的职业标出来——因为这些领域会发生剧烈变化。不是说岗位数量一定减少或增加(那取决于需求弹性等很多因素),而是说这些职业的工作内容、技能要求会发生巨大改变。这就像给人类超级有机体升级了一套新的神经系统。

主持人:从你看数据的感受来说,对于现在面临就业市场、或者在考虑学什么、发展什么技能的人,你有什么观察或者建议吗?

Karpathy:这个真的很难一概而论,因为职业太多样了,情况千差万别。但总体来说,这些工具出现得太新、太强大了,所以第一件事就是尽量跟上它们的发展。

很多人会选择忽视它,或者因为害怕而回避——这完全可以理解。但我觉得最重要的是保持好奇、主动去接触和使用它们。因为它们确实是极其强大的新生产力工具。

现在AI其实就是一个非常强大的工具。很多工作本质上是一堆任务的集合,其中一部分任务可以用AI让速度变得非常快。所以大家现在应该主要把它看成一个工具。至于长远未来会怎样,其实挺难预测的,我也不是专业做这方面预测的人,这应该交给经济学家去认真研究。

10.

OpenAI的研究员

正“光荣地”把自己自动化掉

主持人:你是工程师啊。我觉得有意思的一点是,现在对工程岗位的需求其实还在持续上升。我不确定这是不是暂时的现象。你怎么看?

Karpathy:对,我觉得现在软件其实是稀缺的。正因为稀缺、太贵,所以需求才没有爆发。如果门槛大幅降低,就会出现“杰文斯悖论”——东西变得更便宜,人员需求反而增加了。

经典例子就是ATM机和银行柜员。很多人一度担心ATM和电脑会把柜员彻底取代,但实际上因为银行开支店的运营成本大幅下降,反而开了更多分行,最后柜员数量反而增加了。这是大家常引用的例子。本质就是:某样东西变便宜了,很多之前被压抑的需求就被释放出来了。

所以我在软件工程这个领域其实是谨慎乐观的。我觉得软件的需求会变得极大,因为它变得便宜太多了。

而且软件本身太强大了——它是数字信息处理,你不再被迫使用那些不完美的、别人给你的工具,你也不用只能接受现成的东西。代码现在是临时的、可变的、可修改的。所以我认为未来会在数字世界里出现大量“重构一切”的活动,这会创造非常多的需求。

长远来看呢,像OpenAI、Anthropic这些前沿实验室,现在也就雇一千来个研究员吧。这些研究员某种意义上是在“光荣地”把自己自动化掉,他们其实就是在主动做这件事。

我有时候去OpenAI转转,就会跟他们说:你们有没有意识到,如果我们真的成功了,我们全都要失业啊?我们就是在给Sam(OpenAI联合创始人兼CEO Sam Altman)或者董事会造一个能取代我们的东西啊。

有些研究员自己也开始有那种“精神错乱”的感觉,因为它真的在发生。他们会想:完了,连我也完了。

11.

在前沿AI Lab之外

跟“人类整体”立场对齐度更高

主持人:你为什么不干脆去前沿实验室,用海量算力跟一大群同事一起做自动研究(auto research)?就像前几天Noam Brown所问的那样?

Karpathy:其实我之前在那里待过一段时间,也算是重新出来过。我觉得这个问题可以从很多角度看,有点复杂。

我现在感觉,在前沿实验室之外,人们其实也能产生非常大的影响,不管是行业外还是生态层面的角色。比如你现在做的就是生态层面的工作,我目前也更多是在生态层面,我觉得这类角色能带来的影响其实挺好的。

反过来,如果太深度绑定到某一家前沿实验室,其实也有问题。因为你会有巨大的财务激励,而你自己也承认AI会极大地改变人类和社会,却在里面一边建技术一边从中获利。这个难题其实从OpenAI刚创立时就存在,一直没完全解决。

你在公司里面就不是完全自由的个体。有些话你不能说,有些话组织希望你说。虽然不会强迫你,但那种压力是存在的——说错话会很尴尬,会被侧目,会被问“你在干嘛”。所以你在里面其实很难保持完全独立的立场。

我在实验室外面,反而觉得自己跟“人类整体”的立场对齐度更高,因为我几乎不受那些压力影响,想说什么就说什么。当然,前沿实验室里你也能做出很大贡献,尤其是如果你想法很强、能参与核心决策。现在整体风险还不算特别高,大家都还挺友善。

可一旦真正到高风险、利害攸关的时候,作为一个员工,你对公司最终决策到底有多大影响力,其实我是不太确定的。你可以在会议室里提想法,但你并不是真正掌舵的那个人。的确存在一些错位。

另一方面,我也同意一个观点:如果你完全在实验室外面,判断力确实会慢慢漂移。因为你接触不到最前沿的东西,看不到模型到底是怎么工作的,未来会怎么发展。

所以从这个角度,我确实有点担心。我觉得保持跟前沿的接触是重要的。如果有机会去前沿实验室干一段时间,做一些高质量工作,然后再出来,也许是个不错的方式——既能跟上真实进展,又不至于完全被某个实体控制。

所以我觉得Noam如果在OpenAI应该也能做出非常好的工作,但他的最高影响力也许恰恰是在OpenAI外面。

理想状态可能就是来回切换、在里面和外面都待一待。这是一个复杂的问题,我自己就是先进去,又出来,未来可能还会再进去。我大概就是这么看待这件事的。

12.

开闭源模型差距明显收敛

AI生态需维持健康的权力平衡

主持人:开源模型到底离前沿模型有多近,这个差距会持续吗?我觉得整个事情的发展其实挺让人意外的。从一开始只有少数几个中国模型和全球模型,到现在大家都在持续发布,而且能力上比很多人预想的要更接近前沿。

你长期做开源,对此怎么看?会不会觉得惊讶?

Karpathy:我大概的观察是:闭源模型仍然领先,但大家都在盯着“开源模型落后几个月”这个差距。一开始是完全没得比,后来拉到18个月左右,现在已经明显在收敛,可能现在落后6–8个月的样子吧。

我当然是非常支持开源的。拿操作系统举例:有封闭的Windows和macOS这样的大型软件项目,就像未来的大模型一样;但同时也有Linux,它其实极其成功,跑在全球绝大多数计算机上(我记得上次看是60%还是更多)。因为行业需要一个大家觉得安全、可信的共同开放平台。

现在大模型也是同样的逻辑,行业其实有强烈的需求,希望有这样一个东西存在。唯一的区别是,现在做这件事需要巨量的资本投入,这让竞争变得更难。

但我认为现在的开源模型已经非常好用了。对于绝大多数消费级场景,甚至终端开源模型都足够强。往前再走几年,很多简单用例都会被很好地覆盖,甚至可以本地跑。

当然,永远都会有一部分对“最前沿智能”的需求,而且这个需求可能占很大一块市场。但也许未来的“前沿”会变成那种诺贝尔奖级别的工作,或者像把Linux从C重写成Rust这样的大工程。封闭的最强模型可能会主要服务这类高难度任务,而开源则会吃掉大量基础和日常用例。

而且现在封闭实验室的“前沿”模型,过几个月可能就开源了,然后继续干很多活。所以我预计这个动态会持续:前沿实验室保持封闭的最强模型当“神谕”,开源模型落后几个月,但差距可控。我觉得这其实是个挺不错的整体格局。

因为我对完全封闭的智能还是有系统性风险的。历史上看,极度中心化的东西(不管是政治、经济还是其他系统)表现都不太好。

我希望开源就算不是最强的,但最好也只是稍微落后一点,作为整个行业都能用的共同工作空间。这样权力平衡会比较健康。

主持人:另一方面,我也觉得有很多大问题要靠持续推进最前沿的智能才能解决。人类面临的一些超级难题,没法只靠今天的能力搞定,所以我们还是得支持那些愿意花大钱往前推的实验室。

但正如你说的,今天的“前沿”如果过一阵子就开源,那本身就已经是非常大的能力释放了。这种智能的普惠化,我觉得既实用又有益。

Karpathy:所以某种意义上,我们现在这个局面其实挺意外地还不错,甚至可以说是个相对健康的生态。

主持人:而且只要这种动态能持续得久一点,整个生态的“面积”(累积的能力)就会越来越大。

Karpathy:不过最近闭源模型好像反而更集中了,因为很多原本跑在前面的玩家现在掉队了,所以头部更集中。我其实不太喜欢这个趋势。我希望有更多前沿实验室,越多越好。我对集中这件事就很警惕。

机器学习里ensemble(集成)总是比单个模型强,所以我也希望最难的问题是有多组人在思考、最难的决策是有多组知情的人在房间里讨论,而不是关起门来两三个人说了算。我觉得那不是好的未来。

所以长话短说:我希望会有更多的AI实验室,开源模型能一直存在,目前稍微落后一点其实是好事。

13.

与操作“比特”相比

操作原子“难上100万倍”

主持人:你之前做过通用机器人的前期工作,也就是自动驾驶相关的研究。最近几个月机器人公司也加速了,很多公司在泛化能力、长时序任务上进步很大,还有很多钱涌进来。你觉得机器人真的要起来了?最近有没有什么变化让你改观?

Karpathy:我的看法还是受当年自动驾驶的影响比较大。自动驾驶其实就是第一个真正落地的机器人应用。十年前那波,有一大堆初创公司,最后能活下来的其实没几个。

我看到的是:机器人这东西太难了,很多脏活累活,需要巨量的资本、时间和信念。“原子世界”就是要比“比特世界”难很多。所以我认为物理世界的机器人会明显落后于数字世界。

数字世界现在就出现了巨大的“解锁效应”——很多原本低效的东西,效率可以提升100倍。因为比特就是比原子好搞太多了。

目前最活跃、最会发生巨变的还是数字空间。然后才会慢慢到数字-物理的接口部分。

为什么会有接口?因为一旦你有了更多Agents代表人类做事、互相协作、参与“Agent经济”,纯数字的任务总有一天会做完。到那时你必须去问宇宙问题,必须做实验,让物理世界给你反馈,才能学到新东西。

现在数字世界还有大量“过剩工作”——人类以前根本没足够脑力把所有已数字化的信息都思考一遍。现在AI来了,我们会先把这些过剩的部分榨干。

但迟早会榨完。然后就开始需要跟物理世界交互的接口:传感器(读世界)、执行器(改世界)。所以我觉得真正有趣的公司会出现在这个接口地带——能不能给超级智能喂数据,能不能按它的指令去操控物理世界。

而纯物理世界的机会其实更大,总潜在市场(TAM)可能比纯数字世界还大。但因为原子难搞太多,所以会滞后。我认为要难上100万倍。时间线大概是先数字大爆发,然后是数字-物理接口,最后才是纯物理的大规模起飞。

主持人:当然,有些物理任务其实没那么难。比如只是在物理世界及逆行“读写”——读可以用现成摄像头、传感器;写可以用现成机械臂。如果你足够聪明,不用投太多钱也能搞出很有价值的东西。

Karpathy:比如我最近去拜访的朋友Liam,他是Periodic的CEO,他们在用AI做材料科学的自动研究。那里传感器的成本就很高,是实验室设备。生物学也一样,很多人在搞生物工程,传感器远不止摄像头。

还有些公司在做“付费采集训练数据”的生意,直接把人类当传感器给AI喂数据。

主持人:所以我觉得未来我会很期待能直接给Agent一个物理世界任务、标个价格,说“你自己想办法搞定,去拿数据”。

Karpathy:现在居然还没有足够发达的“信息市场”,我觉得挺意外的。

比如Polymarket、股票市场这些,如果未来Agent参与度越来越高,为什么不能出现“我出10美元,让人在德黑兰某个地方拍张照或视频”这样的机制?拍完直接喂给Agent,让它们去猜赌局或炒股。

我觉得“Agent化的web”还很早期,还缺很多这样的基础设施。但这种方向我觉得是会发生的。

有一本书可能挺有启发,叫《恶魔》(Demon),里面智能最后有点像在操纵人类——人类既是它的传感器,也是它的执行器。未来整个社会可能会集体重塑,去服务于机器的某种需求,而不是单纯服务于彼此。

主持人:我们之前聊到训练数据缺口、自动研究(auto research)的问题。要把人类从训练闭环里拿掉,让模型自己提需求、自己收集数据、自己优化,得把SFT(监督微调)这一环也高度自动化才行。

Karpathy:对,100%同意。但对于大语言模型训练,其实这个范式特别合适。因为它有清晰的优化目标、损失函数,代码跑得快,还有可量化的指标。

当然,如果完全闭环优化某个指标,可能会出现大量“对指标的作弊”,或者说过拟合。但可以用系统自己再发明新指标,做到更好的覆盖。所以整体来说,语言模型训练其实是目前最容易实现自主闭环的领域之一。

14.

人类互相教授知识的时代要结束了:

先让agent搞懂,然后让它来教人

主持人:最后聊个你的小项目吧——micro GPT。

Karpathy:对,micro GPT是我这十几年一直在干的一件事:把LLM尽可能地简化、提纯到最本质。

我之前做过nano GPT等等项目,现在micro GPT是我目前能做到的最极致版本——整个从头训练一个小型语言模型的代码,只有200行Python(包括注释)。

大家看到那么多复杂的训练代码,其实绝大部分复杂度都来自“要跑得快”。如果不在乎速度,只关心算法本身,那真的就200行,非常好读:数据集、50行网络结构、前向传播、100行autograd引擎算梯度、10行Adam优化器,再加个训练循环,就结束了。

以前我会想录个视频一行行讲,或者写个教程。但现在我觉得没太大必要了。因为代码已经简单到随便丢给一个agent,它就能给你各种角度解释。

我现在更多是在跟agent解释东西,而不是直接跟人解释。如果agent能懂,那它就能按用户的语言水平、无限耐心、反复讲解各种方式。人类反而从agent那里能学得更好。

我甚至可以写一个“skill”,就是告诉agent应该按什么顺序、用什么方式把micro GPT讲给不同水平的人。这样我只负责设计课程的骨架,剩下的执行交给agent。

所以我觉得教育的形式正在被重塑。以前是讲义、讲座、文档;现在更像是:先让agent搞懂,然后让它来教人。

当然现在agent还不是完全取代我——我还是能比它们讲得稍微好一点。但模型进步太快了,我觉得这是一场必输的战斗。

所以教育可能会大幅重构,那种人类互相教授知识的时代可能快要结束了。打个比方,如果我有一个代码库或者其他什么项目,以前你会为使用这个库的人写文档,但现在你不应该这么做了。

你不应该再写给人看的HTML文档,而应该写给智能体看的markdown文档。因为如果智能体理解了,它们就能解释其中的各个部分。这是一种通过智能体的间接传递,我觉得我们会看到越来越多这样的情况发生。

我尝试过让智能体来写micro GPT。我让它试着把神经网络提炼成最简单的东西,但它做不到。micro GPT是我痴迷一生研究出的结晶,就200行代码。我思考了很久,这就是解决方案。相信我,不可能更简单了。

这就是我的价值所在。其他所有东西,智能体都能搞定。它可能想不出来,但它完全能理解,也明白为什么要用某种方式实现。

我的贡献大概就是这几个关键部分,但之后所有的教育工作就不再是我的领域了。也许教育的模式确实会改变——你只需要注入那些你特别在意、你觉得是课程核心的少数几个点,或是补充更好的讲解方式。

那些智能体做不到的事,现在成了你的工作;而那些智能体能做的事,它们可能比你做得更好,或者很快就会比你做得更好。你应该战略性地思考,到底把时间花在什么事情上。